I siste versjon av ChatGPT gir OpenAI mulighet for å lage sin egen chatbot. Dette inkluderer også å laste opp egne filer, slik at man kan ha dialog med et utvalg av egne dokumenter. Selv om vi i lengre tid har hatt denne type tilgang via vår samarbeidsløsning med Appfarm, så er OpenAI’s egen løsning en svært enkel og brukervennlig løsning for å lage en tilpasset chattetjeneste til egne behov.

Kategoriarkiv: Chatbots

I november i fjor ble ChatGPT fra OpenAI gjort tilgjengelig for alle. Chattetjenesten har fått mye oppmerksomhet. I løpet av fem dager hadde den fått over 1 million nye brukere. Og nå, etter få måneder, skal den ha 100 millioner brukere. Samtidig ser flere andre og tilsvarende chatbots dagens lys, deriblant Microsoft Bing.

Det overraskende er, at det blir lagt opp til at disse chatbotene skal være en kunnskapsassistent, som skal gi svar på det man lurer på. Når chatbotene knyttes opp mot søketjenester innebærer dette en forventning om at de kan formidle korrekt og valid informasjon. Ettersom det raskt ble kjent at dette er blant chatbotenes største problem, er det interessant å se på hvor hensiktsmessig denne sammenkoblingen egentlig er.

Hva innebærer det å bruke chatbots som en informasjonskanal?

Dette innlegget vil derfor fokusere på hvilken betydning det har at chatbots blir koblet opp mot søketjenester. Hva innebærer det å bruke chatbots som en informasjonskanal? Hva kreves for at den kan utgjøre et nyttig verktøy?

Innlegget kommer til å ta utgangspunkt i ChatGPT fra OpenAI og BingChat fra Microsoft, fordi dette er de to chatbotene som er blitt tatt i bruk av flest folk så langt.

Chatbots og digitale dialogtjenester er i en rivende utvikling og det kan være vanskelig å følge med. Forskningsartikler, tidsskrifter og fagbøker på dette området har vokst enormt i omfang de siste årene.

Selv om norskspråklige kognitive chatbots og digitale samtaletjenester fremdeles har en vei å gå før de kan implementeres innenfor ulike fagområder, så vil teknologisk og språklig utvikling medføre at de kommer til å bli avanserte nok til å fungere innenfor komplekse språkområder også på norsk. Et slikt område kan godt bli i form av terapeutiske samtaletjenester.

I vårt siste blogginnlegg handlet det om hvordan det føles å skrive med en chatbot. Dette innlegget skal handle om Hilda, som er vår fysiske robot, som vi kan snakke med. Hun er også basert på GPT-3, men opplevelsen av å snakke med henne er ganske annerledes enn når man skriver med den tekstbaserte chatboten, som for øvrig har fått arbeidsnavnet Helge nå (fordi det passet til Hilda). Hilda og Helge utgjør to nesten diametrale motsetninger på mange måter fordi det å kommunisere via en skriftlig bot vs en verbal bot oppleves svært forskjellig.

Vi har nylig fått tilgang til det som akkurat nå må være den beste og nyeste AI-teknologien som brukes til dialog- og chatbots. Den er basert på GPT-3 modellen som vi har skrevet om allerede, som gir imponerende resultater innenfor alt fra autooversettelser, historiefortelling, nyhetsartikler og programmering innenfor en rekke områder.

Open AI API’et er ikke overraskende utviklet av gjengen rundt Google og en rekke andre samarbeidspartnere, blant annet Microsoft. Det skal presiseres at det er snakk om en beta-utgave.

Den største språkmodellen som finnes i dag er GPT-3. Den ble lansert av OpenAI i fjor, og imponerte en hel verden av AI-interesserte med sine evner til å løse ulike NLP-oppgaver. Modellen er basert på samme arkitektur som sin forgjenger GPT-2, men med 175 milliarder parametere er den mer enn hundre ganger så stor. Den er også trent på et langt større datasett. Dette har vist seg å øke prestasjonen betraktelig. Det har også introdusert konseptet prompt programmering innen NLP. Hva betyr egentlig dette for oss?

I forrige blogginnlegg fortalte vi om prosessen med datamaterialet til Vennen.ai. Her slo vi fast at godt og korrekt språk er viktig når tekstmaterialet skal brukes til maskinlæring.

Da vi gikk i gang med prosessen å utvikle en chatbot på norsk, var det ganske usikkert om dette var mulig å få til. Ønsket var å utvikle en chatbot som kan snakke litt om «alt». Vi kjente ikke til andre som har klart dette på norsk, og det gjør vi fortsatt ikke, selv om det har skjedd en utvikling siden vi startet, blant annet innenfor bedrifts-chatboter.

I lengre tid har vi jobbet med å redigere tekstdata til bruk for maskinlæring til å trene en chatbot. Prosjektet har i høy grad vært et testprosjekt, hvor vi har eksperimentert med ulike datamodeller for maskinlæring, samt ulike former for tekstdata. Det har naturligvis medført en del utfordringer som vi skal forsøke å ta for oss i dette innlegget.

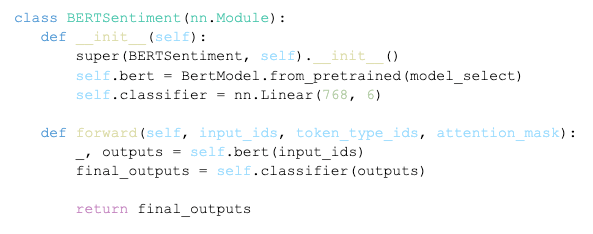

Arbeidet med vennen.ai er til tider utfordrende. Som jeg har kommet inn på i tidligere innlegg, å utvikle en chatbot som kan holde en god dialog er ikke lett. Christina og jeg har kommet litt lengre på veien, men ettersom prosjektet er såpass komplekst har jeg prøvd meg på mindre sideprosjekter og mer konkrete oppgaver inne NLP (Natural Language Processing).

Hvordan kan en maskin forstå hva et menneske sier til den? Og hvordan kan den svare? Dette er spørsmål vi jobber med her på Innovatec, og som vi ønsker å finne gode løsninger på.