Med lanseringen av GPT-4, har AI-markedet fått flere alternativer når det gjelder valg av leverandør. OpenAI med sine GPT-3.5 Turbo og GPT-4. Azure med sin GPT4, som de tilbyr gjennom skybaserte tjenester. Grunnleggende sett er deres modeller det samme. Men hva er forskjellen mellom dem, og hvilke muligheter åpner dette opp?

Tiden det tar for å kjøre en løsning bestemmer hva slags problemer som praktisk kan løses.

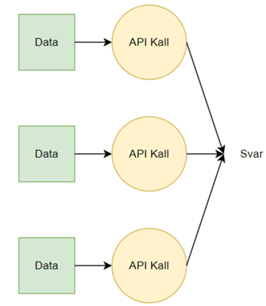

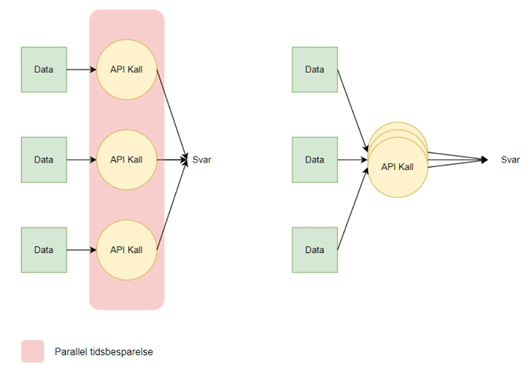

Ved bruk av OpenAI er det mulig for en bruker å sende flere API-kall samtidig, men det er bare ett kall av gangen som kan bli kjørt. Dette innebærer parallell innsending med seriell utførelse. Dette er normalt ikke et problem for de fleste situasjoner, da et API-kall vanligvis er tilstrekkelig for å få løsningen. Imidlertid, i tilfeller der løsningen krever en serie med kall, kan den serielle utførelsen bli et betydelig flaskehals, som resulterer i økt tidsbruk avhengig av antall kall.

Tiden det tar for å kjøre en løsning bestemmer hva slags problemer som praktisk kan løses. Et eksempel er en GPT4 basert chatbot eller søkemotor. Hvis den blir treg på grunn av sin KI-teknologi, kan kunder raskt bli utålmodige. Ved bruk av OpenAI, viser vår testing at denne tregheten kan være et problem. Tilsvarende ved Azure GPT4, viser våres testing at dette problemet blir mindre.

La oss forestille oss en situasjon der en bedrift ønsker å finne spesifikk informasjon i sine dokumenter. Denne oppgaven ville ta flere dager for en person å gjennomføre manuelt. I stedet tar bedriften beslutningen om å automatisere prosessen ved hjelp av GPT4.

Løsningen kunne vært følgende struktur:

Ettersom det er en begrensning på mengden tekst som hvert kall kan håndtere, er det nødvendig å dele opp dataene og sende dem som individuelle kall. I dette scenarioet blir dataene sendt sammen med en instruksjon til GPT4 for å analysere om spesifikk informasjon er tilstede i dataene. Hvis den nødvendige informasjonen ikke finnes, vil det ikke returneres noe svar. Men, hvis informasjonen er til stede vil svaret bli returnert. Kjører man dette via OpenAI, kan det ta en betydelig mengde tid, siden kun et kall kan behandles om gangen. Alternativt, dersom det kjøres gjennom Azure, vil prosessen bli håndtert parallelt. Da vil hele prosessen ta like lang tid som det tregeste kallet i strukturen.

Et lite eksperiment

Vi gjennomførte et lite eksperiment for å finne ytelsesgevinsten mellom OpenAI og Azure. Eksperimentet brukte samme tilnærming som informasjonsuthenting fra dokumenter, som tidligere nevnt. Men i stedet for å bruke bedriftsdokumenter, valgte vi å bruke en Wikipedia-artikkel om OceanGate (https://en.wikipedia.org/wiki/OceanGate).

Jeg inkluderte bare de første seks avsnittene og lagde en avslutning på API-kallet der jeg stilte spørsmålet «[Inneholder denne teksten informasjon om barndomsinteressene til Stockton Rush?]». Jeg kjørte dette kallet 10 ganger for hver modell, og resultatene er oppsummert i tabellen nedenfor.

| OpenAI GPT4 (ms) | Azure GPT4 (ms) | |

| 1 | 3579.9 | 2004.5 |

| 2 | 1341.4 | 2231.7 |

| 3 | 2334.2 | 1611.4 |

| 4 | 1708.1 | 1277.7 |

| 5 | 1632.8 | 1765.6 |

| 6 | 1493.9 | 1759.8 |

| 7 | 3839.8 | 2732.4 |

| 8 | 2337 | 1608 |

| 9 | 1497.9 | 1289.3 |

| 10 | 1312.7 | 1327 |

| SUM | 21077.7 | 17607.4 |

| MAX | 3839.8 | 2732.4 |

Det tok totalt 21 sekunder å gjennomføre 10 kall på rad med OpenAI GPT4, mens Azure GPT4 brukte 17 sekunder. Dette betyr at Azure utfører disse kallene raskere i gjennomsnitt sammenlignet med OpenAI. Imidlertid kan Azure også kjøre disse kallene parallelt, noe som betyr at tiden for det tregeste enkelte kall som var 2.7 sekunder, i praksis representerer den totale tidsbruken for alle kallene. Dette er da en tidsbesparelse på 7.7 ganger.

Basert på disse faktorene, kommer vi til konklusjonen at vi foretrekker Azure GPT4. Ikke bare er enkelte kall raskere, men muligheten til å kjøre dem parallelt bidrar til å akselerere løsningene på mer komplekse problemstillinger.